|

|

, f0 S) X( O: g6 a , f0 S) X( O: g6 a

: U/ B* D! m: S0 b

作者 | 小宋是呢,CSDN 博客专家

* m! B# U" O% Q+ L7 X" N本文精选自 CSDN 博客

! T( a* F* x9 e/ M3 L! D# ]封图 | CSDN 付费下载自东方 IC

! } k7 u0 G% ]1 u |7 l; U6 k, w( S

4 ^( x# v- `9 o* B" x! Z0 b9 R

2 j% q* @' H: Z/ G' [序篇

4 [" W( d3 a% `* Z" G# m$ l4 [' B5 {

I* q. b/ B4 o: R( X2015 年 11 月,Google 正式发布了 Tensorflow 的白皮书并开源 TensorFlow 0.1 版本。

$ r# S) M9 W" d+ v2017 年 02 月,Tensorflow 正式发布了 1.0.0 版本,同时也标志着稳定版的诞生。

: W( L5 I6 l- V2 `$ X2019 年 10 月,TensorFlow 在经历七个多月(2019 年 3 月 1 日 -2019 年 10 月 1 日)的 2.0 Alpha 版本的更新迭代后,发布 2.0 正式版。+ V* M1 A, R# _& ?: ?) a

" l1 k5 o& P, ]. V* r" ^2 y2.0 正式版官方介绍视频

! ?& j D+ K0 u3 H" }- y& t& v虽然 2.0 正式版才刚刚发布,就已经引起了学术界与科研界广泛关注与好评:

3 L+ B; o; ?2 U" P- z* h

+ M& _& P' X+ N! W" y" Y* _6 E- Google 深度学习科学家以及 Keras 的作者表示,TensorFlow 2.0 是一个新时代的机器学习平台,这将改变了一切。. [" _/ Q1 ~0 G8 r! {: Y7 ]6 I

- 深度学习研究和教育者、fast.ai 创始人 Jeremy Howard 也称赞 2.0 版本的发布是”令人兴奋的一步,与 TensorFlow 一代相比是一个巨大的飞跃“。

6 u6 Y% s0 d3 t$ |. J- }5 y - 目前 GitHub 上排名第一的 NLP 机器学习课程 practicalAI 的作者以及苹果公司 AI 研究员 Goku Mohandas 在推特上说,他们正在从 PyTorch 转向 TensorFlow 2.0。3 Z7 b. t; R+ n" _8 d

为什么 TensorFlow 2.0 的发布能够引发了广泛的讨论和关注?下面笔者通过对于 TensorFlow“奋斗史”介绍与解读来分析 TensorFlow 如何成就的王霸之路。

/ x% p" Q5 U, _) A" `* i: @TensorFlow 的“奋斗史”包括三个章节:锋芒初露(0.1),中原逐鹿(1.0),王者归来(2.0)。

7 H4 U9 _3 m, s! l% k

# ^) I8 ]1 e9 g# m# K8 Z5 r) ~: w$ l {; z4 |

1 k+ o9 t5 l7 D- P# _, a9 L8 f& G/ a/ S

锋芒初露·源起

( P. e& M/ \2 B( k% `4 J6 U

" i( |! O+ _' O/ ?+ l/ V. s) [6 i

在 2011 年,Google Brain 内部孵化出一个项目叫做 DistBelief,它是为深度神经网络构建的一个机器学习系统。虽然这个著名的系统并没有开源,但是 Google 研究者有大量关于它设计的论文被大家所熟知,它也被广泛应用于 Google 内部的科研和商业产品中。这个项目最早可以追溯到 2009 年,由 Geoffery Hinton 带领的团队开发的一个实现了广义反向传播算法的框架,基于这个框架,Google 内部可以快速试验新的深度学习算法并提高算法精度。比如在使用这套框架后,Google 内部语音识别的错误率降低了 25%。; |. V2 y& S7 t/ M

后来,Google 决定将 DistBelief 打造成更加稳健、快速、通用的机器学习框架,调动了相当多的工程师和科学家投入到对 DistBelief 的改造,这其中就包括大名鼎鼎的 Jeff Dean。有了这样的豪华开发阵容,DistBelief 迅速成熟蜕变,成为一个高鲁棒和工业级的机器学习框架,这就是后来于 2015 年 11 月发布的 TensorFlow 0.1 版。* \, P$ J$ J+ G& h O% K a6 j9 X% W

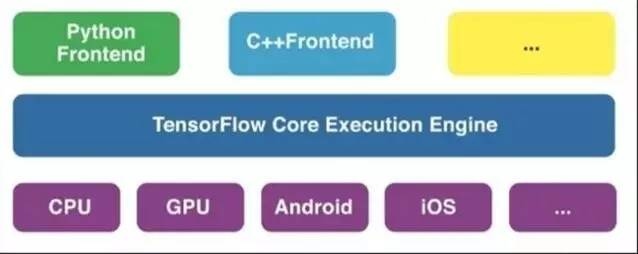

虽然相较于较早开源的 Caffe、MXNet 等优秀的机器学习框架,TensorFlow 还略显年轻,但是作为 Google 内部的第二代机器学习框架,TensorFlow 有了更加有趣的灵魂。相较于侧重于卷积的 Caffe 与刚从校园走出来的 MXNet,TensorFlow 以更加成熟完备的姿态展露锋芒。它是基于 DataFlow 的计算模型,算子相组合形成一个计算图,计算的过程就是数据在这个计算图的节点进行计算并流动。同时,这个计算图可以被切成不同的子图,并分配到不同的 Device 上,包括 CPU、GPU 和其他的计算设备,这样天然地对分布式友好。此外,TensorFlow 从一开始就被设计成运行在多个平台上,如 inference 可以运行在 iOS 和 Android 设备上,训练则可以运行在不同的硬件设备上。2 Q$ h& T" Z: [$ a

2016 年 4 月 14 日,Google 发布了分布式 TensorFlow,版本号为 0.8,这是 TensorFlow 发布之后的比较重大的版本更新。Google 的博文介绍了 TensorFlow 在图像分类的任务中,在 100 个 GPUs 和不到 65 小时的训练时间下,达到了 78%的正确率。在激烈的商业竞争中,更快的训练速度是人工企业的核心竞争力。而分布式 TensorFlow 意味着它能够真正大规模进入到人工智能产业中,产生实质性影响。

3 c: \' ?9 G: ]$ H: h在 2016 年 6 月,TensorFlow 发布了新版本的早期版本,版本号为 0.9,增加了对 iOS 的支持。随着谷歌增加了 TensorFlow 对 iOS 的支持,应用程序将能够在更聪明的功能集成到它们的应用程序,最终使它们更聪明和能干。8 _2 ^+ v% ^. C8 r* \

0 x" D. P$ W9 x% l7 Z 0 x" D. P$ W9 x% l7 Z

从 0.9 版本开始,TensorFlow 支持了多平台,并且进入高速发展时期,开始不断赶超并拉开与其他深度学习框架的距离。虽只是源起,却锋芒毕露,初现王霸之气。! X. S2 f4 E" w# r x- N! T6 ?

, J1 I! N; b( x' F8 \* A* H7 L, c; d9 t1 d" L

V; s: z! M) ~! z$ w% ]9 s3 h8 f

中原逐鹿·盛极" O1 t4 U+ j7 C1 h# H5 [

" T, _9 s4 u. H% W( j

$ `, X' ~- G( `4 j时间到了,2017 年 1 月初,谷歌公布了 TensorFlow 1.0.0-alpha ,即 TensorFlow 1.0 的第一个“草稿”版本。2017 年 2 月,TensorFlow 在发布了 1.0.0 版本,也标志着稳定版的诞生。8 o$ [% t3 h2 r* W, \' j/ z/ Y) n! V

与已有版本相比,全新的 TensorFlow 1.0 主要有以下改进:( f% d O: z& C5 c7 S; V9 f( k- g

2 q# Q/ ?4 R1 d! Y4 r- 更快:TensorFlow 1.0 超乎想象地快!TensorFlow 1.0 为未来更多的性能改进打下了基础,而 tensorflow.org 现在可提供模型优化的提示和技巧,以达到最高速度。

% k* p' U. _+ V - 更灵活:TensorFlow 1.0 为 TensorFlow 引进了带有 tf.layers,tf.metrics 和 tf.losses 模块的高级别应用程序界面。TensorFlow 团队引进能够与 Keras 完全兼容的新 tf.keras 模块。$ M3 O/ n; d, K2 F$ E

- 随时就绪:TensorFlow 1.0 可确保 Python 应用程序界面的稳定性 Python 能够在不打破现有代码的情况下,更容易地获取新功能。

' ]5 N* N w7 z4 G5 d

1.0 版本不仅为 TensorFlow 机器学习函数库带来多重升级,而且为 Python 和 Java 用户使用 TensorFlow 做开发降低了难度。另外,新版本的修补也得到了改善。更有意思的是,由于对 TensorFlow 计算做优化的新编译器,在智能手机上运行基于 TensorFlow 的机器学习 APP 将成为可能。Tensorflow 它已成为 GitHub 最受欢迎的开源项目。

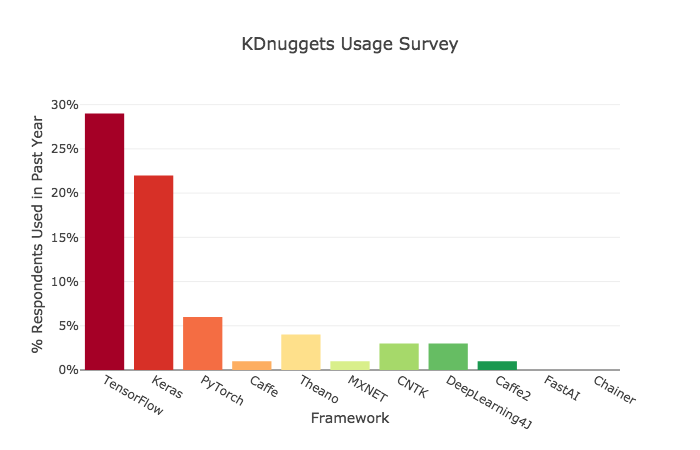

( X; w: a* Z$ u0 d0 `- H3 _下图是 KDnuggets 网站对 2018 年的机器学习框架的使用做的一个调查统计,可以看出当时 TensorFlow 已经遥遥领先于其他竞争(Keras 是一个上层封装,底层调用的还是 TensorFlow),奠定了其深度学习霸主的地位。

, P$ f2 U- t0 Q% w6 h / R0 G1 |3 `! M# { / R0 G1 |3 `! M# {

中国有句古话:盛极必衰,否极泰来,这句话对于 Google 的 TensorFlow 也同样适用。1.x 版本在高速发展过程中,也为自己后来发展筑起一道山,TensorFlow 也产生了很多被人诟病的地方,比如 API 的稳定性、效率和基于静态计算图的编程上的复杂性等。同时,坚持静态图模式也培养起来了足以撼动 TensorFlow 霸主地位的框架(上述图中默默无闻的第三名,后来强势崛起的 PyTorch)。

' y& w3 }$ D }2 G- p1.x 版本后期,TensorFlow 发展由于自身原因(1. 为自己后来发展筑起一道山 2.坚持静态图模式)遭遇到瓶颈。PyTorch 以动态图开发模式,统一化的模块命名方式,更加人性化的编程的方式(Pythonic),强势出道。这些优势无一不击中 TensorFlow 的痛点,不断追赶、威胁 TensorFlow 霸主地位。* A t/ d3 y7 I

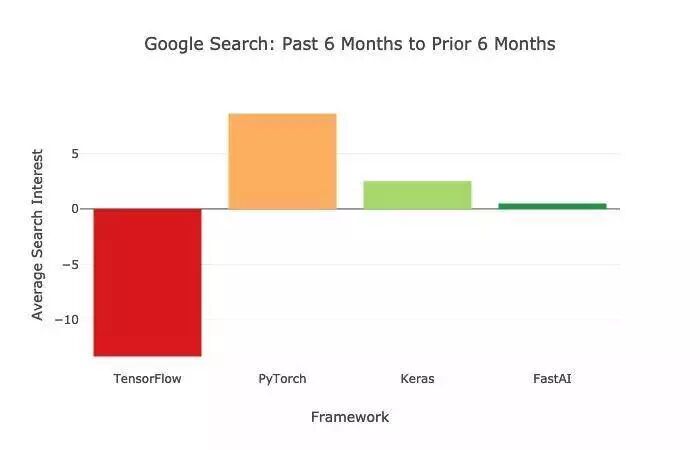

下图通过搜索全世界对机器学习和人工智能类别的兴趣(Google Interest),采用过去六个月的平均兴趣分数,并将其与前六个月的平均兴趣分数进行了比较。可以看出,TensorFlow 的平均兴趣分数处于下降状态,PyTorch 却呈上升趋势。' O* W$ i) |2 T' J" f

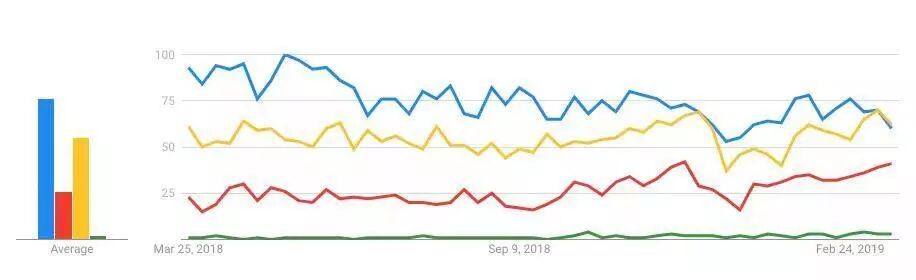

; t2 ^& d* ^1 R; s+ J/ L+ M+ {7 D下面谷歌的图表显示了过去一年的搜索兴趣。TensorFlow 为蓝色,Keras 为黄色,PyTorch 为红色,fastai 为绿色。可以看出 TensorFlow 总体呈现下降趋势,而 PyTorch 却呈现持续增长姿态,不断缩小与 TensorFlow 的距离。

, X/ w$ Y! j7 g- y

( g9 N" \/ s/ N4 L' ?按这样的趋势,PyTorch 在用户搜索兴趣方面追赶上 TensorFlow 指日可待了,TensorFlow 遭遇到出生以来最大的挑战(其实 TensorFlow 也就才三岁多)。TensorFlow 会如何应对这个挑战呢?是按部就班,在 1.x 版本上进行小修小补,得过且过(这个词用得有些过了,之所以会用是刚好写到这里的时候听到这首歌,同时这个词语与表达笔者对上述方法的不苟同);还是推倒重来,重新设计新版 TensorFlow,涅槃重生。这个选择会关乎到以后 TensorFlow 数年的发展和与 PyTorch 竞争的成败。笔者相信,Google 并不会做选择,小孩才会做选择,大人全都要。以谷歌的巨大体量,在内部执行两个方案,最后看市场反馈推出最合适的。Google 是大公司,以稳为主的策略还是很容易让人理解的。

: |3 Z! k+ @, v& A- T- u. b# s, a6 v4 I! T' b2 P6 g/ h, J- P

; z& J1 O0 N8 W5 W+ Y& U$ W

' w# Y0 \7 @9 V; r7 f9 g

王者归来·槃涅- f/ }& t( z. I2 |( M+ @

% b8 ~+ A; t3 B3 l0 ?4 i! R

3 Q" U# {" y9 f0 v: e: a1 b6 {

我们都知道 Google 推出了后者方案,选择涅槃重生,重塑自身。那么全新的 TensorFlow 2.0 究竟新在哪里呢?TensorFlow 官网给出了答复:3 d- M! r% G0 i( Z o$ `$ q

3 y: d& G$ W; n) c' m8 }

- Keras 与 TensorFlow 紧密集成,默认 eager execution,执行 Pythonic 函数。官方表示,对开发者来说,TensorFlow 2.0 用起来跟 Python 差不多;对于研究者来说,新框架也在低级 API 方面进行了重点投入。6 w/ A6 b! D( r, X( B

- 为了在各种平台上运行,SavedModel 文件格式进行了标准化。2 K: C, t1 J. w. ?

- 针对高性能训练场景,可以使用 Distribution Strategy API 进行分布训练,且只需进行少量代码修改就能获得出色的性能。支持 Keras Model.fit、自定义训练循环、多 GPU 等等。/ D. x( C! ?/ C8 B0 F

- TensorFlow 2.0 提高了在 GPU 上的性能表现。以 ResNet-50 和 BERT 为例,只需要几行代码,混合精度使用 Volta 和 Turing GPU,训练表现最高可以提升 3 倍。: X2 ? C3 j* f/ x" G

- 新增 TensorFlow Datasets,为包含大量数据类型的大型数据集提供了标准接口。

& R9 C& |9 @9 P% z, o2 q - 虽然保留了传统的基于 Session 的编程模型,但官方现在建议使用 eager execution 进行常规的 Python 开发。tf.function 装饰器可以把代码转换成可以远程执行、序列化、性能优化的图。在 Autograph 的帮助下,能把常规的 Python 控制流直接转成 TensorFlow 控制流。

3 P$ j1 ]0 L1 a; v1 z% \+ X - 官方提供了 TensorFlow 1.x 升级 2.0 的迁移指南,TF2.0 还有一个自动转换的脚本。" \; a9 F6 Z$ p6 U/ B9 k; F3 ]1 N

- TensorFlow 2.0 提供了易用的 API,能够灵活快速的实现新想法。模型的训练和 serving 也已经无缝集成在基础架构中。) R1 K% e5 [% o1 ]

- 更多关于 TensorFlow 2.0 的信息,可以访问官网:https://www.tensorflow.org/5 S( A& d. H5 U6 h1 \/ \) D

8 N& K: W' T! R# } 8 N& K: W' T! R# }

几乎每一条都直击 TensorFlow1.x 用户的痛点,广大使用 TensorFlow1.x 转到 PyTorch 的用户表示 TensorFlow 2.0 真香,纷纷倒戈。( ?; s7 c/ D. n

Google 深度学习科学家以及 Keras 的作者表示,TensorFlow 2.0 是一个新时代的机器学习平台,这将改变了一切。

, y1 y9 d+ B( ?) L深度学习研究和教育者、fast.ai 创始人 Jeremy Howard 也称赞 2.0 版本的发布是“令人兴奋的一步,与 TensorFlow 一代相比是一个巨大的飞跃”。1 V$ o6 r( _) `0 V" J3 j

目前 GitHub 上排名第一的 NLP 机器学习课程 practicalAI 的作者以及苹果公司 AI 研究员 Goku Mohandas 在 Twitter 上说,他们正在从 PyTorch 转向 TensorFlow 2.0。4 Q: b) ]4 k0 M- g; p, r: G# e. h

此后,PyTorch 在与 TensorFlow 的争霸中将再难有胜算,TensorFlow 1.x 版本的失误给了 PyTorch 赶超的机会,PyTorch 已尽力追赶了,但是还是没有实现赶超。Now,TensorFlow 2.0 已经补全缺点,同时具备比 PyTorch 更加完备的多平台支持、更成熟的部署方式与数量巨大的用户基数。如果 PyTorch 早出生一年,或者 TensorFlow 2.0 晚发布一年,PyTorch 还是有机会的,但是没有如果,Google 依旧是最强大科技公司之一,很难反复给对手机会赶超。TensorFlow 再次呈现对于其他框架压倒式优势,实现王者归来。

2 k9 |/ [ x: B4 t

! d, B" E' [# ^# Q

* j: O* J$ V, k |, F2 d1 @% T2 Z

$ S. h G* a7 o0 r* Z1 ~终章- ?: @1 b/ W7 B' w9 U* j1 x

2 v- R! l4 L+ z

: I( A% Z1 x- Z/ ~

- L; ?1 j% ?" {+ E8 uTensorFlow 从最开始 0.1 版本诞生时受到广泛关注,到 1.0 版本的全面爆发,再到今年 2.0 版本正式发布,它已趋于完美。TensorFlow 的成长依托于 Google 的强大研发与号召力,但 TensorFlow 的成功更归功于设计的完备性、审时度势和适时革新。: d* x; x- @. _8 q

经历四年时光,TensorFlow 的发展与成功离不开先天的优秀天赋(Google Brain),更有赖于后天的努力拼搏(适时革新)。有天分又有努力,TensorFlow 的成功理所应当。& |' `4 }% f+ V! p! g

附:; P+ u1 I2 ?( w$ X9 d& _

想要体验正式版本 TensorFlow 2.0 可以访问=>『TensorFlow2.0 正式版教程』极简安装 TF2.0 正式版(CPU&GPU)教程:

1 S' ]9 t: D# o0 L6 W; M9 [ |https://xiaosongshine.blog.csdn.net/article/details/101844926/ G: x+ O6 V$ Z+ b% U1 v$ ]! e

扫描下方二维码,下载 CSDN App,即刻与博主互动起来!

$ I+ C& l C6 p0 b) {8 `6 O+ Y# t

【END】

8 A/ {: }& f7 j) e5 S ) p1 r( {, N* k5 p) u4 \ ) p1 r( {, N* k5 p) u4 \

热 文 推 荐 - l. j B* V1 P l8 R. D. y

☞ 蚂蚁金服自研数据库打败Oracle拿下世界第一;三星手机全面退出中国;微软发布Windows 10X双屏系统 | 极客头条☞ 中国物联网激荡 20 年!

/ ^. i: z. M, C2 G; }: {% S☞ 鸿蒙 OS 的微内核技术究竟是什么?☞ 200 行代码解读国产数据库阿里 OceanBase 的速度源头!| CSDN 博文精选

2 j5 N( F. q' `☞ 程序员 45 岁怎么了?!☞对比C++和Python,谈谈指针与引用☞肖仰华:知识图谱构建的三要素、三原则和九大策略 | AI ProCon 2019☞以太坊交易量第一合约FAIRWIN被爆漏洞, 竟是因为这个接口被滥用…… 点击阅读原文,即刻与博主互动起来。1 A/ v: d. z- m& u' T! ]0 @* q1 \# V 点击阅读原文,即刻与博主互动起来。1 A/ v: d. z- m& u' T! ]0 @* q1 \# V

你点的每个“在看”,我都认真当成了喜欢 你点的每个“在看”,我都认真当成了喜欢

, X1 q5 m, B4 q来源:http://mp.weixin.qq.com/s?src=11×tamp=1570273204&ver=1894&signature=wbyR5eEK5ZNuCYUNykmgSbu7lZdav7yVeotRnfrhvE*aLGBype63FQP9YgT5B2PjfShoStsKB9izwIC-OLC2YyqInaVXUYykzxGSKYW*HJypZrly6mkJ98trZtQEPJrN&new=1

8 I# ]8 M0 u/ Q( m% p1 Z免责声明:如果侵犯了您的权益,请联系站长,我们会及时删除侵权内容,谢谢合作! |

本帖子中包含更多资源

您需要 登录 才可以下载或查看,没有账号?立即注册

×

|

|手机版|小黑屋|梦想之都-俊月星空

( 粤ICP备18056059号 )|网站地图

|手机版|小黑屋|梦想之都-俊月星空

( 粤ICP备18056059号 )|网站地图