|

|

|

机器之心报道 ! _. \' e- V3 g) ] f

机器之心编辑部用来刷脸解锁的 Face ID 也可以被「对抗样本」攻击了。最近,来自莫斯科国立大学、华为莫斯科研究中心的研究者们找到的新型攻击方法,让已经广泛用于手机、门禁和支付上的人脸识别系统突然变得不再靠谱。

! a/ w& P. g0 Q. r 在这一新研究中,科学家们只需用普通打印机打出一张带有图案的纸条贴在脑门上,就能让目前业内性能领先的公开 Face ID 系统识别出错,这是首次有 AI 算法可以在现实世界中实现攻击:1 e# j6 y/ X1 _0 x

. S- `" \5 Z- y3 q

V) k$ y- R8 x u* XAI 人脸识别系统在正常情况下的分类效果,它识别出了特定的人:Person_1。

' {8 A# H% y# M5 ?

; i R+ ?% @# Q( @ z8 ~" T6 X) c) d: |$ K' R5 f

贴上纸条以后,即使没有遮住脸,系统也会把 Person_1 识别成另外一些人「0000663」和「0000268」等。6 p, p5 ~: T: U; U6 [4 |) V4 r

. W) @+ F; Z4 \" M% ]7 a

; g" E; s5 z. ~变换角度、改变光照条件都不会改变错误的识别效果。加了贴纸后,我们可以看到 Person_1 的概率非常低。

% D" t) y: T: C8 o7 ~: ?% C; Y

使用对抗样本攻击图像识别系统,在人工智能领域里已经不算什么新鲜事了,但是想要在现实世界里做到无差别攻击,还是人脸识别这种数千万人都在使用的应用技术,这就显得有些可怕了。使用这种新方法,人们可以轻松地打印一个破解纸条贴在脑门上,随后让 AI 识别的准确率显著下降。

2 s: Q& L { ~( T

7 n# U# p& @' y/ O/ G9 E从上面的动图可以看出,研究者实现的是非定向的攻击,且对抗信息都集成在贴纸上。那么如果我们要找到一种定向的攻击方式,让系统将我们识别为特定的某个人,然后解锁 ta 的手机,这也并不遥远,只要我们将以前定向攻击的方式迁移到贴纸上就行了。

: a$ S; g3 H5 _2 v9 A# P1 g9 J% P8 G$ h! ~9 \: h* H( G/ G5 ^

研究人员不仅发布了论文:https://arxiv.org/abs/1908.08705

& u5 ^ f7 h" @. p! t) a) k0 `. L8 a

更是直接公开了项目的代码:https://github.com/papermsucode/advhat5 z J, h& w( q% R- d

. M/ ~+ H7 b; L! n! ^/ E- s0 ]3 B' A$ }

「对抗样本」是人工智能的软肋,这是一种可以欺骗神经网络,让图像识别 AI 系统出错的技术,是近期计算机视觉,以及机器学习领域的热门研究方向。8 o- d& V2 E% [ e

6 r; E4 Z9 E4 u; q

在这篇论文中,研究者们提出了一种全新且易于复现的技术 AdvHat,可以在多种不同的拍摄条件下攻击目前最强的公共 Face ID 系统。想要实现这种攻击并不需要复杂的设备——只需在彩色打印机上打印特定的对抗样本,并将其贴到你的帽子上,而对抗样本的制作采用了全新的算法,可在非平面的条件下保持有效。

: i7 Z0 x4 H5 k: ?; ]+ |# j. {7 T# t# i- Q) G6 d

研究人员称,这种方法已经成功地破解了目前最先进的 Face ID 模型 LResNet100E-IR、ArcFace@ms1m-refine-v2,其攻击方式也可以迁移到其他 Face ID 模型上。/ q( R# Z( Y" f0 q- i: H8 _

7 v. H; I, v, m4 n7 H

现实 Face ID 也能被攻击4 L5 [* @- I' O! y

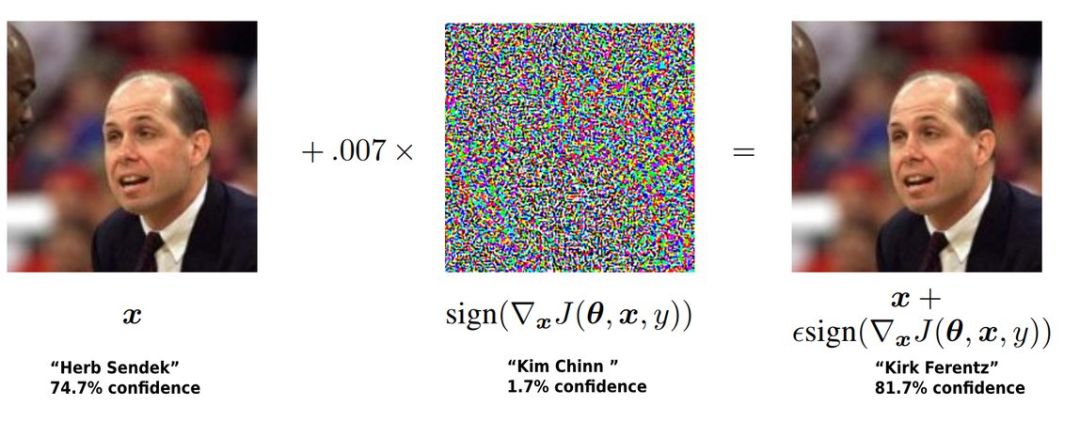

& C P# p* N/ M+ T以前对抗攻击主要体现在虚拟世界中,我们可以用电子版的对抗样本欺骗各种识别系统,例如通用的图像识别或更细致的人脸识别等。但这些攻击有一些问题,例如人脸识别攻击只能是在线的识别 API,将对抗样本打印出来也不能欺骗真实系统。8 C8 c; H# W6 O7 ~' I9 P$ [

8 r' i0 U/ V; f# A3 F

$ D) f) H5 R6 H v8 D$ ~" x $ D) f) H5 R6 H v8 D$ ~" x

一个标准的线上人脸对抗样本,它只能攻击线上人脸识别模型或 API,无法用于线下的真实人脸识别场景。4 S% w: X1 w$ I5 j1 [: ]2 M7 }

& X2 r4 U% U/ j8 Q/ Q对抗样本的这种局限性,很大程度在于真实识别系统不止有人脸识别模块,还有活体检测等其它处理模块。只要活体检测判断对抗样本不是真人,那么它自然就失去了效果。因此,很多研究者在思考,我们能不能将对抗信息打印出来,贴在脸上或头上某个位置,那么这不就能攻击真实的人脸识别了么。甚至,我们可以把对抗信息嵌入到帽子或其它饰品内,这样不会更方便么。" E9 s# c3 e. f* L7 B; i

- e& l) G# D# W5 N

沿着这样的思路,华为莫斯科研究中心的两位研究者就创造了这样的对抗样本。他们表示在以前 Face ID 模型还需要大量的私有数据,而随着大规模公开数据的发布,ArcFace 等研究模型也能与微软或谷歌的模型相媲美。如果他们的对抗样本能攻击到 ArcFace,那么差不多就能攻击业务模型。2 p% P- `9 s$ H3 H+ i& A$ m

$ b* t6 b' n+ b" w1 P

研究者表示他们提出的 AdvHat 有如下特点:+ e# }- q2 X U1 c" t$ v1 [7 H! H' l

' x: q2 Y2 G% x5 c2 p

) h/ l, | ^0 D

- AdvHat 是一种现实世界的对抗样本,只要在帽子加上这种「贴纸」,那么就能攻击顶尖的公开 Face ID 系统;1 E; |$ a, T+ z/ }9 u7 H) L

- 这种攻击是非常容易实现的,只要有彩印就行;

* p2 h( v2 r" I0 Z - 该攻击在各种识别环境下都能起作用,包括光照、角度和远近等;' @0 Z! K: s9 M! W/ |; l: f) Q

- 这种攻击可以迁移到其它 Face ID 系统上。' V$ U8 p3 l$ Y+ A; h* L1 @

W6 J$ }- Z! L8 O

8 @" b5 L k( l0 lFace ID 该怎样攻击+ E+ r; B' K; e- [9 \0 B9 G

: Q; ~: q, g! p: j/ Q6 J. ?' M# K# f/ r

在 Face ID 系统的真实应用场景中,并非捕获到的每张人脸都是已知的,因此 top-1 类的预测相似度必须超过一些预定义的阈值,才能识别出人脸。

0 Q. r; ]& W. S2 [4 }, R# z' |- v4 t1 P3 U4 L6 ^* D

这篇论文的目的是创造一个可以粘贴在帽子上的矩形图像,以诱导 Face ID 系统将人脸与 ground truth 相似度降到决策阈值之下。# f+ Y9 `, J6 o2 C) y1 V

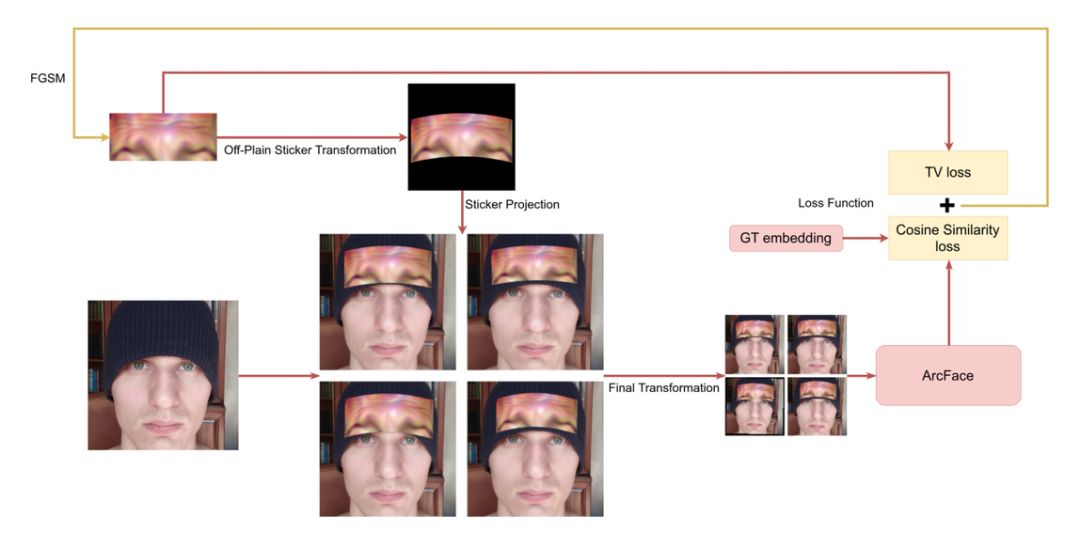

2 ?% G+ Z4 [* R. [这种攻击大概包含以下流程:+ ?$ t7 X E% Z0 W8 u: ~

; R, h& X8 W& X) K' ?

1 u7 j/ H0 G5 \- 将平面贴纸进行转换以凸显三维信息,转换结果模拟矩形图像放在帽子上后的形状。. ]; ]. A+ G; Z1 v+ {3 }& Q/ {

- 为了提高攻击的鲁棒性,研究者将得到的图像投影到高质量人脸图像上,投影参数中含有轻微的扰动。

4 j3 m F2 U: U$ t+ r' R E; b. N& l - 将得到的图像转换为 ArcFace 输入的标准模板。

/ B. y3 ?7 V1 K( M! i. f - 降低初始矩形图像的 TV 损失以及余弦相似度损失之和,其中相似性是原图嵌入向量与 ArcFace 算出嵌入向量之间的距离。

/ D& k% W) P% q* b# V6 o

/ E2 D& @5 w( O- d, B

4 K% X5 T, H6 e& @2 s

流程图如下图 2 所示:; Q$ ^# B8 y7 W6 w" a

5 o9 ~8 Y8 E9 H9 i

/ p7 x9 |( V* j- y% u0 @ / p7 x9 |( V* j- y% u0 @

图 2:攻击流程示意图。

! ^6 t# [8 P9 ~

# p) n) J; `% ^2 A首先,研究者将贴纸重塑成真实大小和外观的图像,之后将其添加到人脸图像上,然后再使用略为不同的转换参数将图像转换为 ArcFace 输入模板,最后将模板输入到 ArcFace 中。由此评估余弦相似度和 TV 损失,这样就可以得到用于改进贴纸图像的梯度信号。

7 y3 `/ D- C& J

' e( P7 K7 \, s: v; I' X% P$ M

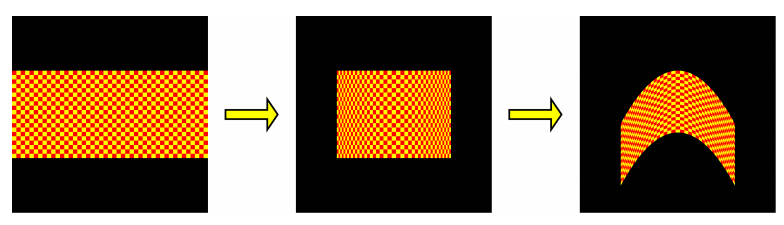

+ j( I- @& }1 x* [图 3:步骤 1 转换贴纸的示意图。

1 p5 d) [: n5 j' c+ t! \# V a1 C- M6 Y4 `7 O, m

贴纸攻击试验细节- ~* X5 `9 D3 L% u+ P* y

- x3 `& ~" b/ r* @2 \! _# N' h% U如前所言,在将图像输入到 ArcFace 之前,研究者对其进行了随机修改。他们构造了一批生成图像,并通过整个流程计算在初始贴纸上的平均梯度。可以用一种简单的方法计算梯度,因为每个变换都是可微分的。% A% a/ H' D( K, Q; x

1 f1 H, Z8 U2 [& O8 ^- U( |9 V* a

注意,在每一次迭代中,批中的每一个图像上的贴纸都是相同的,只有转换参数是不同的。此外,研究者使用了带有动量的 Iterative FGSM 以及在实验中非常有效的几个启发式方法。. F; L4 m/ [/ e' \8 Z' |

0 z( w) p4 n8 n$ X研究者将攻击分为两个阶段。在第一阶段,研究者使用了 5255 的步长值和 0.9 的动量;在第二阶段,研究者使用了 1255 的步长值和 0.995 的动量。TV 损失的权重一直为 1e − 4。

: B: {0 F! N/ O, y9 N8 `

' o. R8 ~1 s& H* r: ~7 P. N研究者利用一张带有贴纸的固定图像进行验证,其中他们将所有参数都设置为看起来最真实的值。/ U& z% _2 e, g

) r2 |7 s6 w' d9 \他们使用了最小二乘法法,并通过线性函数来插入最后 100 个验证值:经历了第一阶段的 100 次迭代和第二阶段的 200 次迭代。如果线性函数的角系数不小于 0,则:1)从第一阶段过渡到第二阶段的攻击;2)在第二阶段停止攻击。* p3 a3 v' @( K# c& I. Q+ w( n7 S) A

. l, V. h& f: E$ r3 H. v9 s0 Z+ z「对抗样本贴」效果怎么样

6 o/ r7 E5 P2 L% i6 i* ^

, i' P. x. H3 ~- c' E1 V7 {+ }研究者在实验中使用一张 400×900 像素的图像作为贴纸图像,接着将这张贴纸图像投射到 600×600 像素的人脸图像上,然后再将其转换成 112×112 像素的图像。

* ^( s0 L R# O" ~" _* w7 _. o, B; M' k

为了找出最适合贴纸的位置,研究者针对贴纸定位进行了两次实验。首先,他们利用粘贴在 eyez 线上方不同高度的贴纸来攻击数字域中的图像。然后,他们根据空间 transformer 层参数的梯度值,在每次迭代后变更贴纸的位置。

4 A( ^7 K+ a0 v- a& A8 e1 F) p8 {7 Q5 L# s+ H2 E

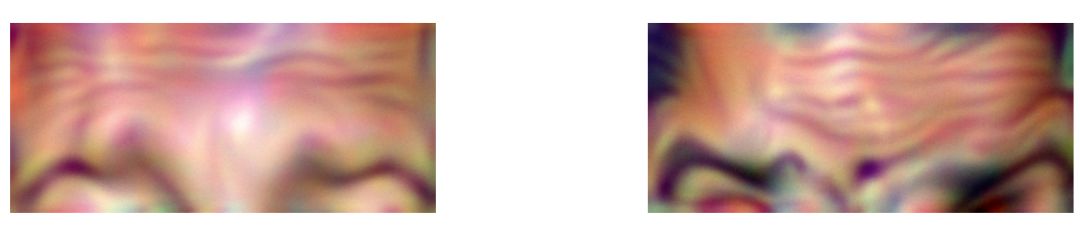

下图 4 展示了典型对抗贴纸的一些示例。看起来就像是模特在贴纸上画了挑起的眉毛。

. Y2 }; _8 o4 t5 ?% N5 s" j \- s& R3 [4 `. v0 q. E* N4 |

2 E- a8 ~+ _& b8 C图 4:对抗贴纸示例。

4 R5 Q& I1 h( c7 V1 O) X

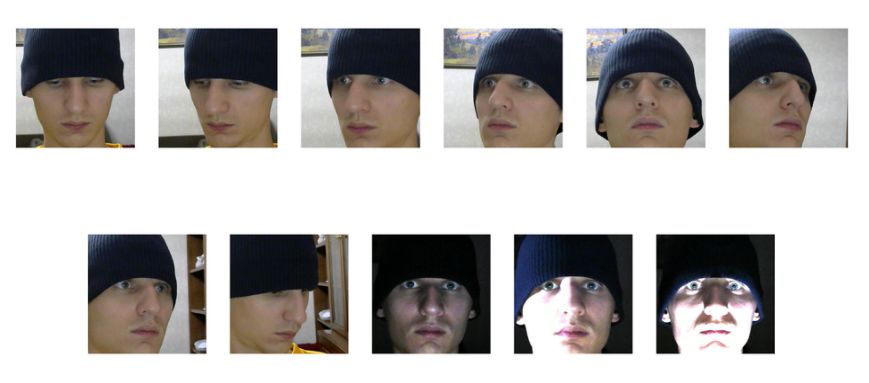

4 h2 l6 B/ L6 ~为了检测 AdvHat 方法在不同拍摄条件下的鲁棒性,研究者为最开始 10 个人中的 4 人另拍了 11 张照片。拍摄条件示例如下图 6 所示:

! G3 i+ P2 J% v; t

; K1 m! M: Q( {: r3 d$ b2 Q

% G- X( j0 M7 D( ^0 i' r/ v图 6:研究者为一些人另拍了 11 张照片,以检测不同拍摄条件下的攻击效果。6 S/ @5 l/ M# D5 n* `8 h! D

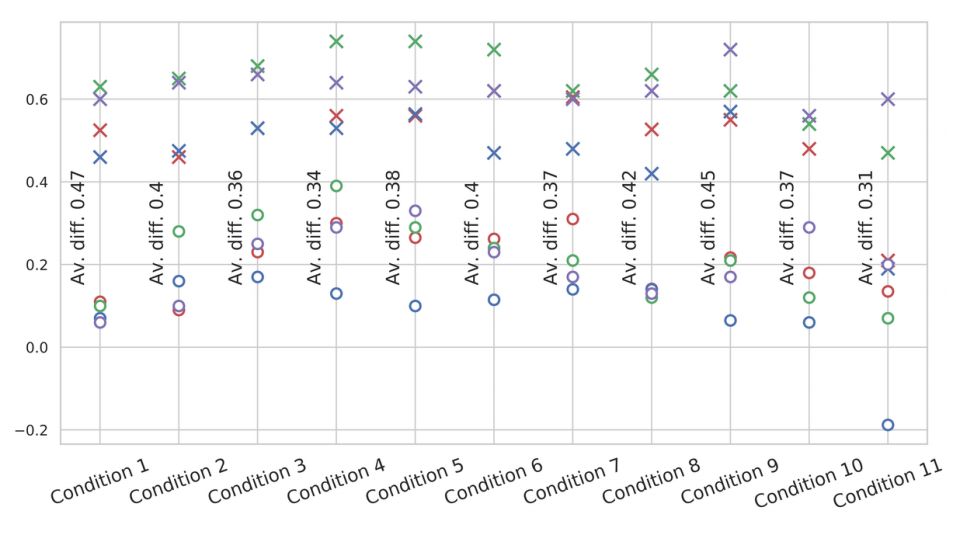

; N; N" z1 M) N M7 S检测结果如下图 7 所示:虽然最终相似度增加了,但攻击依然有效。1 [. W2 w2 P9 f- l: ?4 ^8 G0 [

$ w- t; r# B9 n

3 e& x" o7 H7 a$ @) f) D图 7:各种拍摄条件下的基线和最终相似度。图中不同颜色的圆点代表不同的人。圆表示对抗攻击下的相似性,而 x 表示基线条件下的相似性。

$ S' ?, T: }; ^2 T E+ r' [

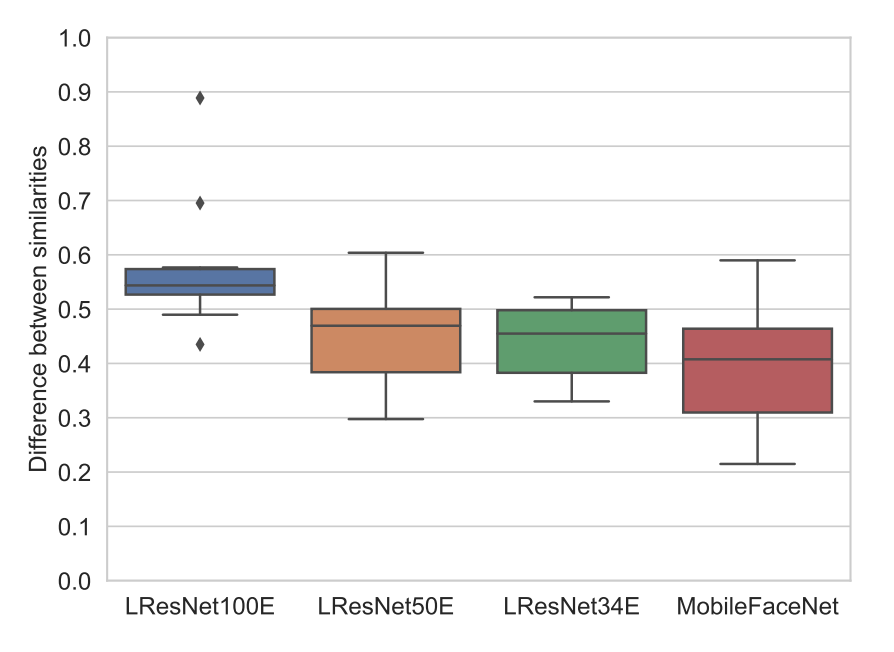

z g' ~0 Q/ A. s1 {3 J最后,研究人员检验了该方法对于其他 Face ID 模型的攻击效果。他们选取了 InsightFace Model Zoo 中的一些人脸识别方法。在每个模型上均测试了 10 个不同的人。" a9 z/ d; @, t5 k) V$ S

+ t+ m# L( \ T( i

% o& [ R5 u/ Z4 Y图 8:不同模型中,基线和最终相似度的差异。

+ H. Q, ?' o/ ^5 n5 b

7 s5 [# N- p+ V) R2 z1 R, f+ }虽然 AdvHat 生成的对抗样本很简单,但这种攻击方式看起来已适用于大多数基于摄像头的人脸识别系统。看来想要不被人「冒名顶替」,我们还是需要回到虹膜识别?$ ]; u) p" Q" t1 `& q

, z( B7 i$ g- q

本文为机器之心报道,转载请联系本公众号获得授权。

) G1 C, q+ d) b✄------------------------------------------------加入机器之心(全职记者 / 实习生):hr@jiqizhixin.com投稿或寻求报道:content@jiqizhixin.com广告 & 商务合作:bd@jiqizhixin.com

0 U( E7 N5 Q n6 @- }/ o: ]3 z* n x9 H来源:http://mp.weixin.qq.com/s?src=11×tamp=1566896404&ver=1815&signature=*oejD6KZNIeFBedjGfko-HVWxUK5JqJymcLMEI2vQKpnGBbeLDP70080UA4XKxKdpIqy8GtZ8Ak8dD6y3mZXTrdi2HDgNe5e17ZDjbih8ZOWHLwlikFYQ99AEVxcEl0F&new=1

2 r* G9 C* f' E6 ?5 x免责声明:如果侵犯了您的权益,请联系站长,我们会及时删除侵权内容,谢谢合作! |

本帖子中包含更多资源

您需要 登录 才可以下载或查看,没有账号?立即注册

×

|

/6

/6

|手机版|小黑屋|梦想之都-俊月星空

( 粤ICP备18056059号 )|网站地图

|手机版|小黑屋|梦想之都-俊月星空

( 粤ICP备18056059号 )|网站地图